[ad_1]

به گزارش آفتاب شرق

گروه یادگیری ماشینی اپل اخیراً با انتشار کردن مقالهای با گفتن «توهم تفکر» (The Illusion of Thinking) موجی از عکس العملها را بین پژوهشگران هوش مصنوعی به راه انداخته است. در این مقاله، پژوهشگران استدلال کردهاند که مدلهای زبانی جاری در واقع فرایند تفکر یا استدلال جدا گانه را انجام نمیدهند. مقالهای تازه انتشار شده که ادعای محققان اپل را رد میکند.

«الکن لاسن»، محقق Open Philanthropy، در مقالهای تازه مدعی شده یافتههای محققان اپل زیاد تر به مشکلات طراحی هوش مصنوعی مربوط است نه محدودیتهای بنیادی در او گفت و گو استدلال. در قسمت نویسندگان این مقاله از مدل Claude Opus شرکت آنتروپیک هم اسم برده شده است.

مقاله لاسن با گفتن «توهم توهم تفکر» یا The Illusion of the Illusion of Thinking مشکلات مدلهای استدلاگر جاری در حل معماهای پیچیده را رد نمیکند اما میگوید اپل محدودیتهای عملی و پیکربندیهای معیوب را با ناکامی قابلیتهای استدلال نادرست گرفته است. ۳ قضیه مهم لاسن با مقاله اپل از قرار زیر است:

- محدودیت توکنها در مقاله اپل نادیده گرفته شده است: لاسن میگوید آنجایی که اپل نتیجه میگیرد هوش مصنوعی نمیتواند معماها را حل کند، دلیلش افتتوکن است، نه ناتوانی در استدلال.

- ناتوانی در روبه رو با معماهای حلناپذیر ناکامی برداشت شده است: آزمون «عبور از رودخانه» انگارً مثالهای حلناپذیر داشته است. لاوسن میگوید اپل بهخاطر شناسایی این معماهای غیرممکن مدلهای هوش مصنوعی را سرزنش کرده است.

- اسکریپتهای برسی بین ناکامی قابلیتهای استدلال و تقطیع خروجی تمایزی قایل نشده است: اپل از پایپلاینهای خودکاری برای قضاوت مدلها منفعت گیری کرده که فقط خروجی کامل و اشاره به تکتک مرحله های استدلال را پیروزی میداند. لاوسن مدعی است این رویکرد علتشده هر خروجی جزئی یا استراتژیک هم ناکامی در نظر گرفته شود.

لاوسن برای قبول سخن بگوییدهایش، آزمونهای اپل را مجدد با شرایطی متفاوت اجرا کرد و نتیجه این می بود که هنگامی محدودیتهای مصنوعی در خروجی رفع میشد، مدلهای استدلالگر بهخوبی میتوانستند مشکلات پیچیده را حل کنند.

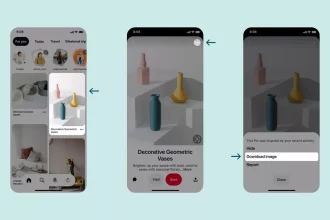

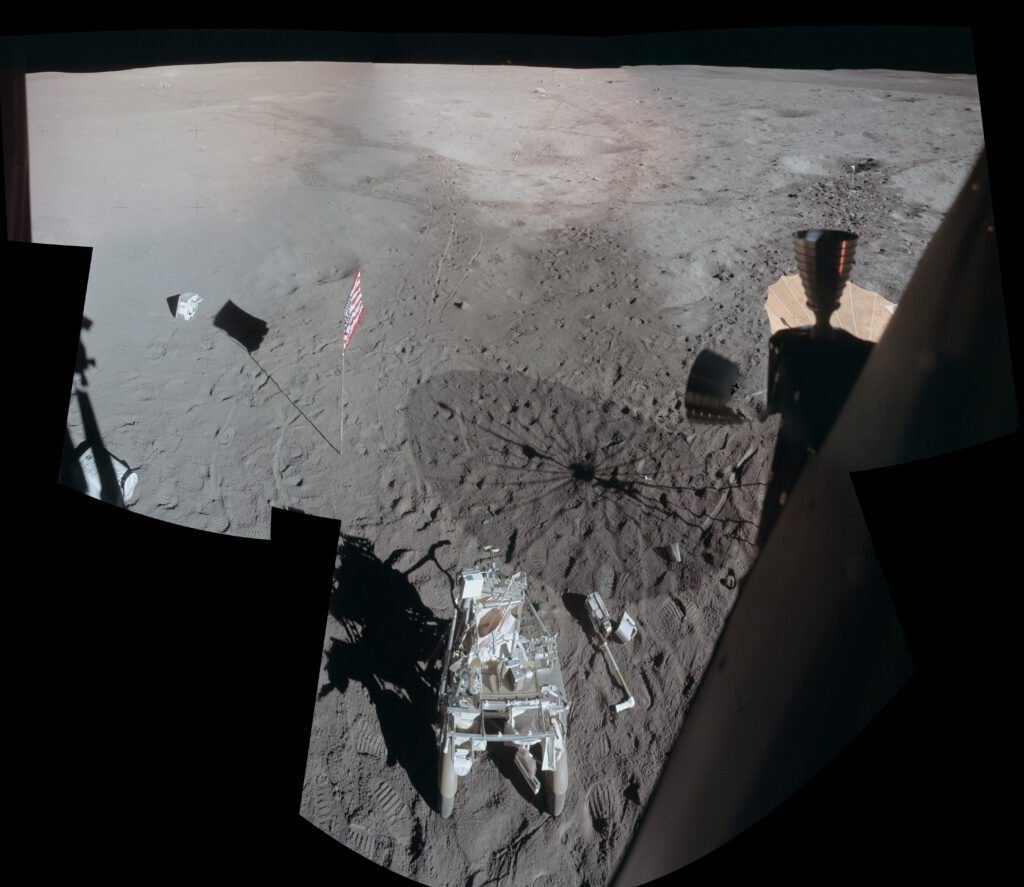

محققان اپل برای برسی توانایی مدلهای زبانی در حل مسائل منطقی، مجموعهای از ۴ معمای کلاسیک شامل «برج هانوی» (عکس بالا)، «دنیای بلوکها»، «معمای عبور از رودخانه» و «پرش مهرهها در بازی چکرز» را طراحی کردند.

این معماها که سابقهای طویل در پژوهشهای علوم شناختی و هوش مصنوعی دارند، با افزایش تعداد مرحله های و محدودیتها پیچیدهتر خواهد شد و نیاز به برنامهریزی چندمرحلهای را الزامی میکنند. پژوهشگران از مدلها خواستند نهفقط به هر معما جواب نهایی بدهند، بلکه روال تفکر خود را نیز مرحلهبهمرحله با منفعت گیری از تکنیک «زنجیره تفکر» (Chain-of-Thought Prompting) توضیح دهند.

مطابق مطالعه اپل، با افزایش پیچیدگی، دقت مدلها افت چشمگیری اشکار میکند و در سختترین ماموریت های به صفر میرسد. اپل این افت را نشانهای از فروپاشی قوت استدلال مدلها میداند.

مخالفت کاربران شبکههای اجتماعی با تحقیق اپل

برخی منتقدان مطالعه اپل، اعتقاد دارند این شرکت تفاوت «ناتوانی در تشکیل خروجی کامل» و «ناتوانی در استدلال» را نادیده گرفته است. آنها پافشاری کردهاند مدلها حتی در برخی ماموریت های، استراتژیهای صحیحی اراعه کردهاند ولی بهعلت محدودیت در تعداد توکن، نتوانستند خروجی را تکمیل کنند.

این چنین برخی معماها، همانند برخی نسخههای عبور از رودخانه، اساساً قابل حل نبودهاند ولی هم چنان مدلها بابت جواب نادرست نمره منفی گرفتهاند.

دسته بندی مطالب

اخبار سلامتی

[ad_2]